एक्स पार्टनर को परेशान करने, उसकी इमेज खराब करने के लिए भी इस तकनीक का इस्तेमाल किया जा रहा है।

नई दिल्ली: आजकल पूरी दुनिया में 'आर्टिफिशियल इंटेलिजेंस' को लेकर बहस चल रही है. हालाँकि, हर सिक्के के दो पहलू होते हैं।

आर्टिफिशियल इंटेलिजेंस ने पहले ही जोर देना शुरू कर दिया है। कहीं इसका गलत इस्तेमाल न हो जाए कि लोगों की निजी जिंदगी संकट में पड़ जाए। स्थिति यह है कि अश्लीलता में भी इस तकनीक के दुरूपयोग की संभावनाएं बढ़ गई हैं।

क्या होते हैं डीपफेक वीडियो ?

डीपफेक वीडियो ऐसे वीडियो होते हैं जो डिजिटल रूप से बनाए जाते हैं। इनमें आर्टिफिशियल इंटेलिजेंस की मदद से बदलाव किए जाते हैं। कई सालों से इस तरह के वीडियो इंटरनेट पर धड़ल्ले से बनाए और प्रसारित किए जाते रहे हैं।

कई साल पहले, एक रेडडिट उपयोगकर्ता ने क्लिप साझा की थी जिसमें एक सेलिब्रिटी का चेहरा कंधे पर लगाया गया था। दरअसल, आर्टिफिशियल इंटेलिजेंस की मदद से पोर्ट ऐक्टर्स के कंधों के ऊपर वाले चेहरों को रिप्लेस किया जाता है। जो कभी-कभी सच लगता है। इस तरह की तकनीक हर किसी के लिए और खासकर महिलाओं के लिए एक बड़ी समस्या बन सकती है।

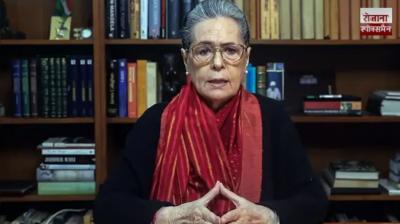

अब डीपफेक भी लोगों को टारगेट करने और इंटरनेट यूजर्स को आकर्षित करने के लिए ऐसे वीडियो बनाते हैं। इसमें पत्रकारों, नेताओं, अभिनेताओं के चेहरों का भी इस्तेमाल किया गया है। इंटरनेट पर इस तरह के हजारों वीडियो हैं। कुछ ऐसे वीडियो भी हैं जो उपयोगकर्ता को अपना चेहरा जोड़ने का विकल्प भी देते हैं। एक्स पार्टनर को परेशान करने, उसकी इमेज खराब करने के लिए भी इस तकनीक का इस्तेमाल किया जा रहा है।

जानकारों का कहना है कि आजकल डीप फेक बनाना बहुत आसान हो गया है। सच्चाई यह है कि तकनीक आगे बढ़ती रहेगी और इस तरह की चीजें भी आगे बढ़ेंगी। ऑनलाइन यौन हिंसा, डीपफेक पोर्न, डीपफेक पोर्न तस्वीरों के जरिए भी लोगों को परेशान किया जाने लगा है।ऑस्ट्रेलियाई विशेषज्ञ नोएला मार्टिन एक घटना का जिक्र करते हुए कहती हैं कि जब एक 28 साल की महिला ने गूगल पर अपनी फोटो सर्च की तो उसे डीपफेक पोर्न मिला। मार्टिन ने कहा कि उसे यह भी नहीं पता था कि वीडियो किसने बनाया है।

इसके बाद उसने कई वेबसाइट्स से संपर्क किया और वीडियो को हटाने की कोशिश की। कई जगह से संपर्क नहीं हो पाया। वह वीडियो को डिलीट करवा देती थी और कुछ दिनों के बाद वह फिर से आ जाता था। इसके बाद लड़की ने कोर्ट का दरवाजा खटखटाया था ।